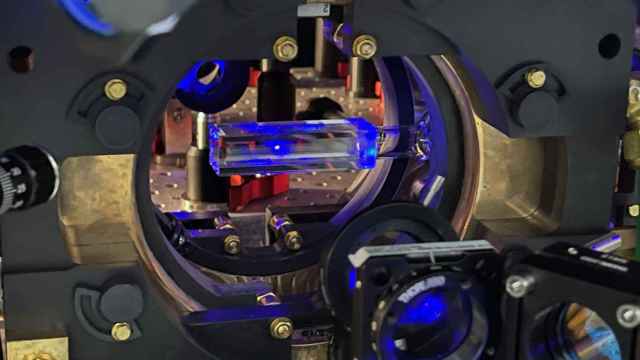

El revolucionario motor que dará una nueva vida a los vehículos diésel: ahorra hasta un 14% de combustible

La empresa china Weichai Power bate de nuevo el récord de eficiencia térmica de un motor diésel, que supera por primera vez la barrera del 53%.